أعلنت Google Cloud عن خطوة استراتيجية جديدة تهدف إلى تسريع تبني تقنيات الذكاء الاصطناعي الوكيلي (Agentic AI) على نطاق واسع، من خلال مجموعة تحديثات متقدمة تشمل إطلاق أنظمة TPU 8t وTPU 8i، إلى جانب تقديم بيئة Agent Sandbox ضمن منصة Google Kubernetes Engine، وهي بنية مخصصة لتشغيل الأنظمة الذكية المعقدة متعددة الخطوات بكفاءة وأمان.

تعتمد هذه البنية الجديدة على معالج Axion المبني على معمارية Arm Neoverse، في خطوة تعكس تحولاً مهماً نحو استخدام معالجات مصممة خصيصاً لتلبية متطلبات الجيل القادم من أحمال العمل الخاصة بالذكاء الاصطناعي.

تحول في متطلبات البنية التحتية للذكاء الاصطناعي

مع انتقال الذكاء الاصطناعي الوكيلي من مرحلة التجارب إلى الاستخدام الفعلي، لم تعد البنى التقليدية كافية. فبدلاً من الاعتماد على عمليات استدلال فردية، تعتمد هذه الأنظمة على سلاسل مستمرة من التفكير، واستخدام الأدوات، وجلب البيانات في الوقت الحقيقي، ما يزيد من الضغط على الأداء، ويجعل المعالج المركزي (CPU) عنصراً محورياً في تحقيق الكفاءة.

وفي هذا السياق، تبرز بنية Arm – وخاصة معالجات Axion – كخيار مثالي بفضل قدرتها على تقديم أداء عالٍ بكفاءة طاقة محسّنة، مما يجعلها أساساً لبناء أنظمة ذكاء اصطناعي قابلة للتوسع.

جيل جديد من وحدات TPU وبنية “AI Hypercomputer”

يمثل الجيل الثامن من وحدات المعالجة Tensor Processing Units تطوراً مهماً، حيث تم فصل مسارات التدريب والاستدلال عبر نسختي TPU 8t وTPU 8i، مع دمج معالج Axion للمرة الأولى لتقليل زمن تجهيز البيانات وضمان استغلال كامل لقدرات المعالجة دون تأخير.

لكن رؤية Google لا تتوقف عند هذا الحد، إذ تعمل الشركة على تطوير مفهوم “AI Hypercomputer”، الذي يجمع بين العتاد والبرمجيات بشكل متكامل. ويأتي إطلاق GKE Agent Sandbox كجزء أساسي من هذه الرؤية، حيث يوفر بيئة آمنة وقابلة للتوسع لتشغيل الأكواد والأدوات غير الموثوقة بسرعة عالية وزمن استجابة منخفض.

ويمكن لهذه البيئة تشغيل ما يصل إلى 300 بيئة معزولة (Sandbox) في الثانية لكل عنقود، مع زمن استجابة أقل من ثانية واحدة لبدء التنفيذ، ما يضع متطلبات عالية على البنية التحتية، ويبرز أهمية تصميم Axion لتلبية هذه الاحتياجات.

تحسين كفاءة الاستدلال وتكلفة التشغيل

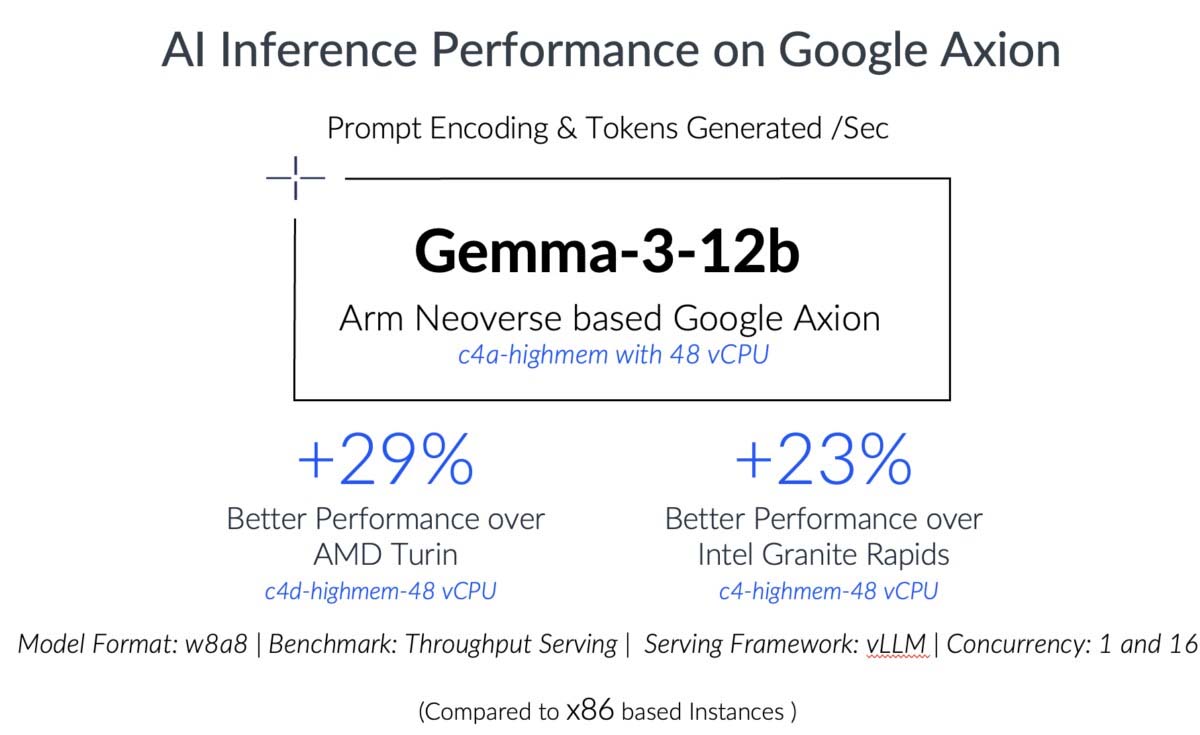

مع توسع استخدام الأنظمة الوكيلية، تصبح كفاءة الاستدلال عاملاً حاسماً. ولهذا تقدم Google Cloud أجهزة C4A الافتراضية المعتمدة على Axion، والتي توفر أداءً عالياً لمعالجة مهام الاستدلال بكفاءة، خاصة في السيناريوهات التي تتطلب توازي العمليات وزمن استجابة منخفض.

وتشير التجارب إلى تفوق هذه الأنظمة على معالجات x86 التقليدية في عدد من أحمال العمل الخاصة بالذكاء الاصطناعي، مع تقديم توازن أفضل بين الأداء والتكلفة، وهو ما يفتح المجال أمام المؤسسات لتوسيع تطبيقاتها الذكية دون تضخم في التكاليف.

توسيع منظومة Axion من السحابة إلى الاجهزة الطرفية

لم تكتفِ Google بذلك، بل وسّعت عائلة Axion لتشمل حلولاً جديدة مثل C4A Metal (قيد المعاينة)، والتي توفر بيئة Bare-metal مباشرة دون طبقة افتراضية، ما يتيح أداءً حتمياً مناسباً للتطبيقات الحساسة مثل أنظمة السيارات الذكية والتطوير المباشر لأنظمة Android.

كما تقدم منصة N4A خياراً اقتصادياً لتشغيل الخدمات واسعة النطاق مثل واجهات API وخطوط البيانات، لتشكّل مع C4A وC4A Metal منظومة متكاملة تغطي مختلف سيناريوهات الاستخدام من السحابة إلى الحافة.

نظام بيئي متكامل يعتمد على Arm

تعزز هذه الخطوات من مكانة Arm كنقطة ارتكاز في مستقبل الحوسبة، حيث تعتمد Google بالفعل على معالجات Axion في تشغيل خدماتها الرئيسية مثل YouTube وGmail وBigQuery وغيرها، مع نقل أكثر من 30,000 تطبيق داخلي إلى هذه البنية.

كما تدعم منظومة برمجية واسعة تشمل شركات كبرى مثل Elastic وMongoDB وRedis، ما يسهل على المؤسسات الانتقال إلى بنية Arm والاستفادة من مزاياها.

نحو بنية تحتية جديدة للذكاء الاصطناعي

مع هذه التطورات، تقدم Google Cloud رؤية متكاملة لبناء بنية تحتية حديثة للذكاء الاصطناعي تعتمد على الكفاءة، والقابلية للتوسع، والتكامل بين العتاد والبرمجيات، ما يمهد الطريق لمرحلة جديدة من التطبيقات الذكية القادرة على العمل بشكل أكثر استقلالية وفعالية.

ابدأ استخدام Google Axion

سواءً كنت تنشر أحمال عمل وكلاء باستخدام GKE Agent Sandbox، أو تُحسّن الاستدلال على C4A، أو تُوسّع نطاق الحوسبة للأغراض العامة باستخدام N4A، فإن Axion يُوفّر أساسًا متسقًا قائمًا على معالجات Arm لبنية الذكاء الاصطناعي الحديثة.

ابدأ استخدام Google Axion على Google Cloud

موارد إضافية:

- مركز موارد ترحيل Arm إلى السحابة

- مسارات تعلّم Arm لـ Google Cloud

- لوحة معلومات نظام Arm البيئي للبرمجيات

- وثائق C4A-metal ونموذج التسجيل للمعاينة